Desde hace algunas décadas, la tecnología va a un ritmo increíble, generando avances que ni siquiera las novelas o películas de ciencia ficción hubieran imaginado, dejándonos con la boca abierta y emocionados porque nos ha tocado vivir en este momento. Sin duda, hemos dado un enorme salto desde aquellos primeros hombres que usaban piedras como herramientas.

La Inteligencia Artificial (IA) se ha ido desarrollando tanto que ahora Microsoft está probando un sistema que es capaz de reproducir cualquier voz luego de analizar tan solo tres segundos de grabación. Este sistema se llama VALL-E y, claro, también tiene sus riesgos porque ahora cualquiera podría imitar una voz y decir cualquier cosa.

Se trata de un software de TTS (Text to Speech, por sus siglas en inglés), que sirve para transformar un texto en audio, solo que está es una versión mucho más avanzada de lo que habíamos conocido hasta el momento. Esta es algo así como la siguiente generación de Waze, el traductor de Google, con un avance significativo respecto a sus antecesores.

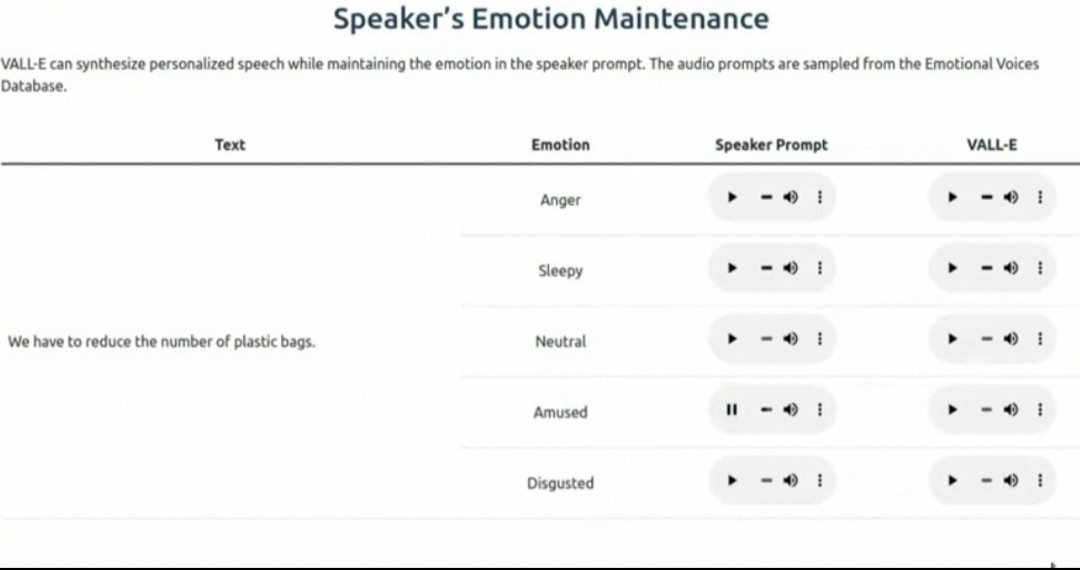

La magia de VALL-E consiste en que convierte el audio en pequeños momentos o tokens, lo que le permite identificar de forma detallada la voz y replicarla idénticamente, pero no solo eso, sino que puede identificar emociones y darle una entonación humana, no como algunas voces muy mecánicas que hemos escuchado.

Como puedes ver, basta con una sola frase para que la IA analice las ondas de sonido y las pueda reproducir en cualquier otra frase que quieras. Además, puedes darle diferentes entonaciones, haciendo que esa voz suene enojada, adormilada, emocionada y más, algo que es totalmente increíble.

Por el momento, el código de esta IA permanece bloqueado, pues en Microsoft saben el riesgo que se corre al imitar en esa forma una voz. Tal vez tu ex la utilice para hacer una grabación en la que digas que quieres volver con ella o utilizar alguna voz para hacer un fraude o cualquier cosa. ¿Te imaginas? Sin duda, el futuro ya está aquí, con sus avances, pero también con todos los peligros que eso implica.